Immaginate per un istante che l’elemento chiave del vostro successo sia improvvisamente esposto agli occhi del mondo intero. È precisamente la situazione in cui si trova Anthropic, un’azienda un tempo discreta, oggi sotto i riflettori a causa di una fuga di codice. Come potrebbe un tale evento influenzare il futuro dell’intelligenza artificiale e delle tecnologie che ne derivano? Scoprite come questo sconvolgimento potrebbe ridefinire il panorama tecnologico attuale.

Le 3 informazioni da non perdere

- L’applicazione Claude di Anthropic è riuscita a superare ChatGPT e Gemini sull’App Store, in particolare grazie alla sua capacità di gestire compiti complessi.

- Un errore umano ha permesso la fuga del codice sorgente di Claude Code, rivelando informazioni cruciali sulla gestione dei progetti da parte dello strumento.

- Sebbene questa fuga non contenga i modelli di intelligenza artificiale stessi, mette a nudo meccanismi di sicurezza, aumentando il rischio di hacking.

Anthropic e l’ascesa di Claude

Anthropic, a lungo rimasta nell’ombra di altri giganti dell’IA, ha recentemente fatto una notevole avanzata grazie alla sua applicazione Claude. Progettata appositamente per trattare compiti complessi, Claude ha rapidamente guadagnato popolarità, superando strumenti come ChatGPT e Gemini. Questa ascesa si spiega in gran parte con l’uscita della versione Opus 4.6, che ha segnato una svolta nell’efficacia dell’applicazione.

Impatto della fuga di Claude Code

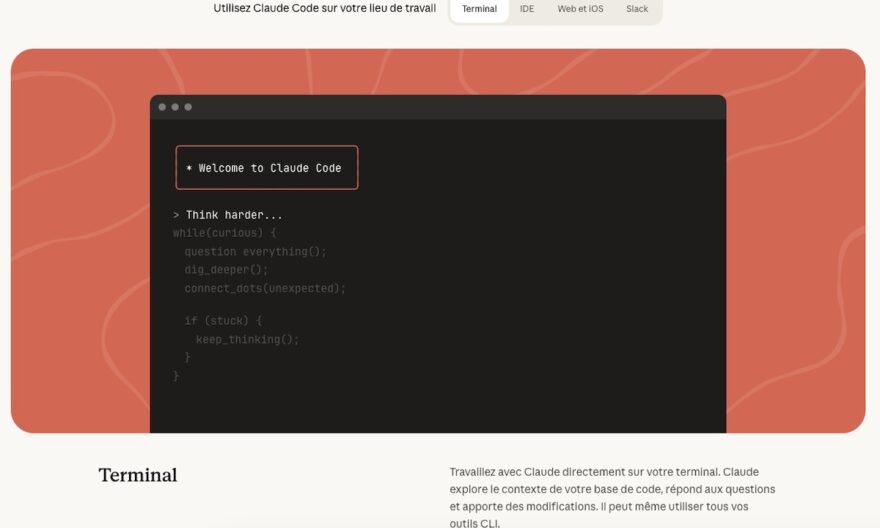

La rivelazione inaspettata del codice sorgente di Claude Code è il risultato di un semplice errore umano durante un aggiornamento del registro npm. Un file destinato al debug interno è stato accidentalmente reso pubblico, offrendo la possibilità di ricostruire l’intero codice. Questa fuga, sebbene non includa il cervello dell’IA, espone comunque molti segreti sul suo funzionamento.

Conseguenze per la sicurezza e la concorrenza

La fuga del codice di Claude Code non è senza conseguenze. Rivela in particolare i meccanismi di sicurezza dello strumento, aprendo la strada a tentativi di hacking volti a sfruttare queste falle. Per Anthropic, di cui una grande parte dei ricavi dipende da questo strumento, la situazione rappresenta una sfida importante. Parallelamente, i suoi concorrenti potrebbero trarre vantaggio da queste informazioni per migliorare le proprie soluzioni.

Il futuro dei modelli open source ispirati a Claude

Con il codice ora disponibile, sviluppatori su piattaforme come Reddit hanno già iniziato a ispirarsi per creare versioni open source. Sebbene questo fenomeno possa aumentare la disponibilità di tecnologie avanzate, solleva anche domande sulla sostenibilità del vantaggio di Anthropic. Il vero test per l’azienda sarà rimanere all’avanguardia dell’innovazione nonostante questa divulgazione.

Le sfide della sicurezza nell’IA

La fuga di Claude Code mette in luce un problema ricorrente nel campo dell’intelligenza artificiale: la sicurezza dei codici sorgente. Le aziende devono raddoppiare gli sforzi per proteggere le loro innovazioni contro le fughe accidentali e gli attacchi malevoli. In futuro, la sicurezza dei dati e degli algoritmi diventerà una questione cruciale per garantire la sostenibilità e la fiducia nelle tecnologie dell’IA.